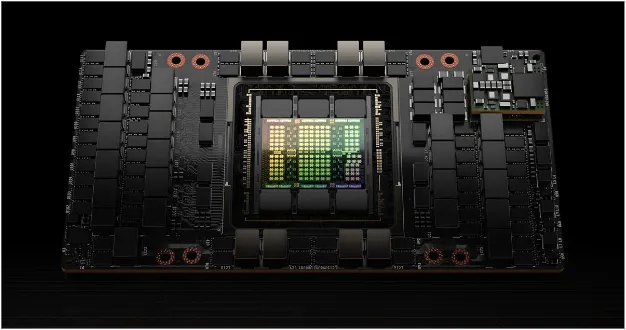

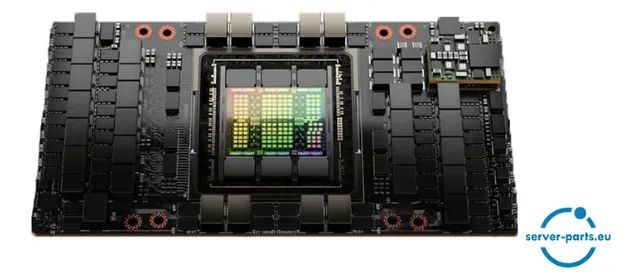

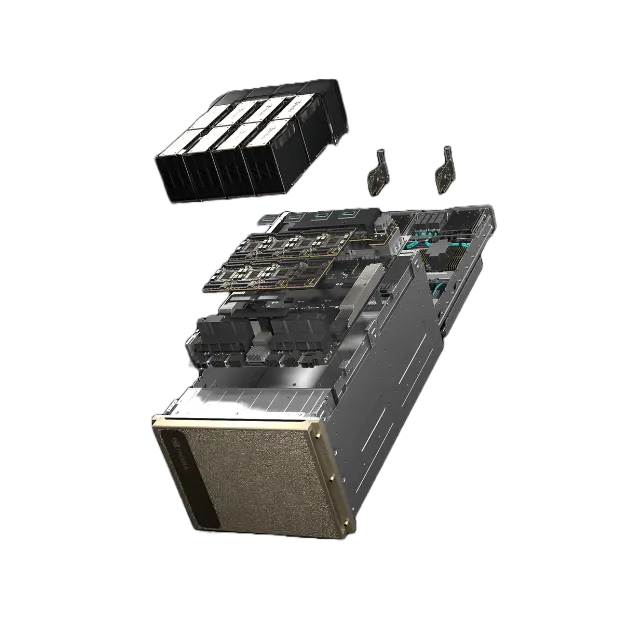

На фото: ускоритель NVIDIA H100 в дата-центровом исполнении (серверный класс, не геймерская видеокарта).

Если вы изучаете видеокарту NVIDIA H100, то почти наверняка сталкивались с непонятными обозначениями: PCIe, NVL, SXM, DGX. На первый взгляд кажется, что это разные модели — но чаще всего это разные форм-факторы и способы интеграции одного семейства ускорителей.

В этой статье разберёмся:

- что означают эти модификации простыми словами

- чем они реально отличаются

- для каких задач подходит каждая

- и как выбрать H100 так, чтобы не переплатить и не упереться в ограничения инфраструктуры

Что такое NVIDIA H100 (коротко)

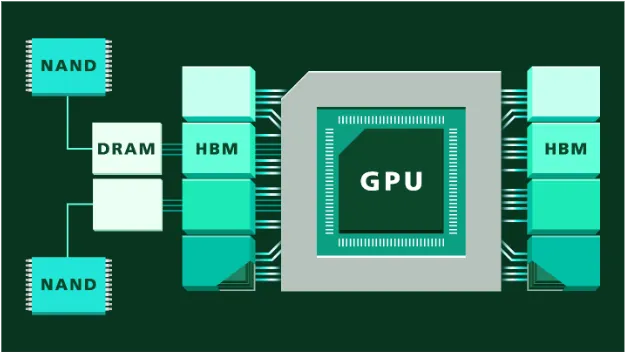

На фото: схема архитектуры Hopper и спецификация H100 (ключевые параметры: память HBM3, пропускная способность, форм-факторы).

NVIDIA H100 — дата-центровый GPU архитектуры Hopper для задач искусственного интеллекта и HPC. Он ценится не за «игровые FPS», а за способность стабильно ускорять:

- обучение нейросетей (training)

- инференс (inference) больших моделей

- высокопроизводительные вычисления (HPC)

Ключевое, что важно покупателю:

- память HBM3: у H100 есть версии 80 GB и 94 GB (в зависимости от варианта)

- пропускная способность памяти: у разных вариантов заметно отличается (это влияет на реальные сценарии)

- разная интеграция: PCIe проще внедрять, SXM даёт максимум связности между GPU через NVLink/NVSwitch

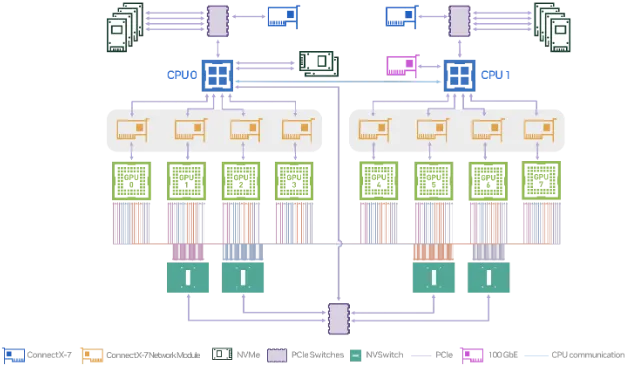

PCIe, NVL, SXM, DGX — в чём вообще разница

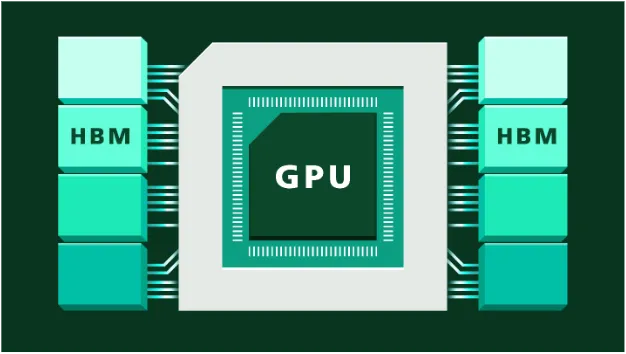

На фото: схемы соединения GPU через PCIe, NVLink и NVSwitch — то, что определяет масштабирование и скорость обмена между ускорителями.

Проще всего представить так:

H100 — это “двигатель”, а PCIe / NVL / SXM / DGX — это “как и куда этот двигатель установлен”.

- PCIe — стандартная «карта» в PCIe-слот сервера (проще всего внедрить).

- NVL — вариант для более эффективной работы в multi-GPU в PCIe-серверных системах, с фокусом на высокий объём/полосу памяти и межGPU-связь (часто 94 GB).

- SXM — модульный формат для специализированных платформ (HGX/DGX), где GPU соединяются через NVLink/NVSwitch максимально быстро.

- DGX — готовая система «под ключ», обычно с 8 GPU, сетями, охлаждением и софтом.

H100 PCIe — самый универсальный вариант

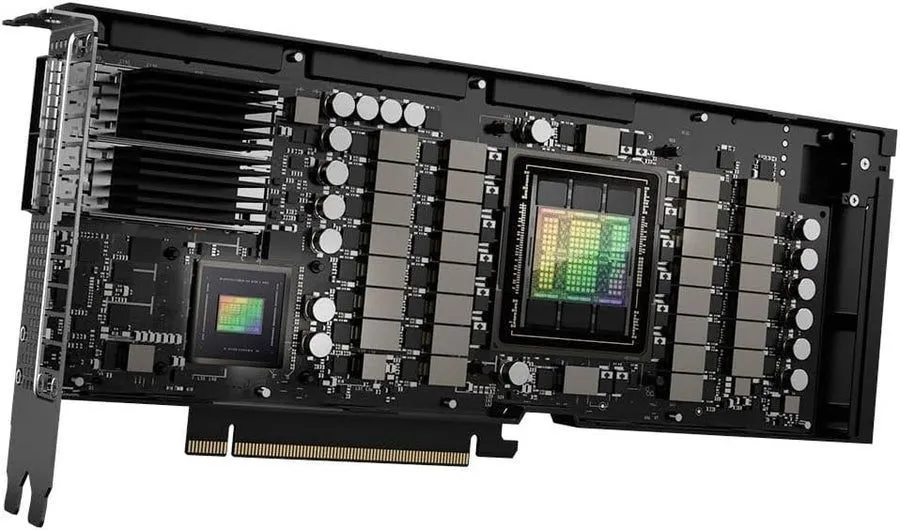

На фото: H100 PCIe — ускоритель в формате платы для установки в PCIe-слот сервера.

Что означает PCIe

PCIe — это стандартный интерфейс подключения ускорителя к серверу. H100 PCIe ставится в PCIe-слот (обычно Gen5), что делает его самым «понятным» вариантом для внедрения в существующую инфраструктуру.

Для каких задач подходит

- инференс LLM/ML-моделей

- продакшн-AI сервисы

- пилотные проекты с 1–2 GPU на сервер

- когда важна простота интеграции и скорость запуска

Что важно учесть

- у PCIe-версии ниже потолок масштабирования по межGPU-обмену, чем у SXM/NVSwitch-платформ

- производительность в рамках одного GPU отличная, но в «тяжёлом» training на много GPU SXM/HGX обычно эффективнее

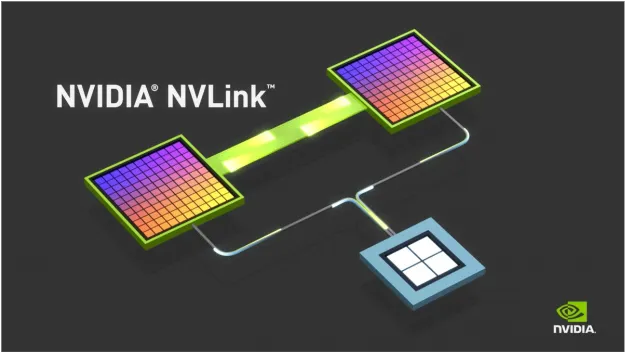

H100 NVL — для высоконагруженного инференса и multi-GPU в PCIe-серверах

На фото: H100 NVL (обычно 94GB HBM3) и концепция NVLink-связи для эффективной работы в multi-GPU.

Что означает NVL

H100 NVL — это вариант, ориентированный на сценарии, где важны инференс больших моделей и масштабирование в PCIe-серверных системах, с акцентом на более ёмкую память (94 GB HBM3) и высокую полосу памяти.

Когда NVL уместнее, чем обычная PCIe

- inference больших LLM, где память и пропускная способность критичны

- серверы с несколькими GPU, где нужно уменьшить узкие места обмена/параллелизма

- когда SXM-инфраструктура избыточна, но «обычной PCIe» уже мало

Нюансы

NVL — это не «магический x2» к мощности. Он раскрывается, когда вы реально упираетесь:

- в объём/полосу памяти

- в эффективность multi-GPU инференса

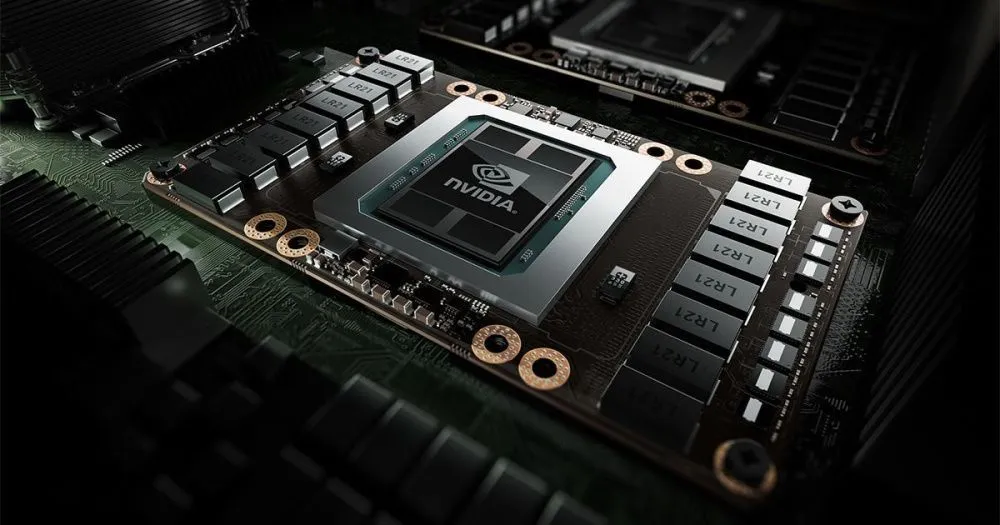

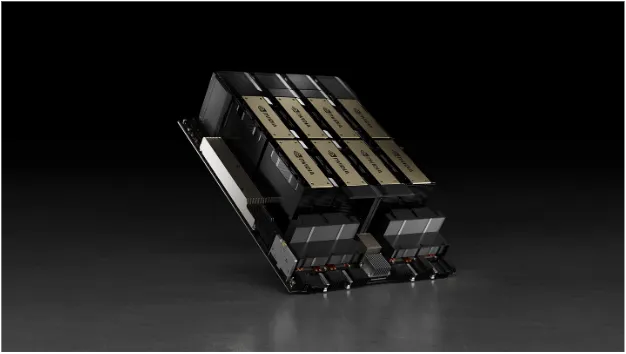

H100 SXM — максимум связности и эффективности для обучения и HPC

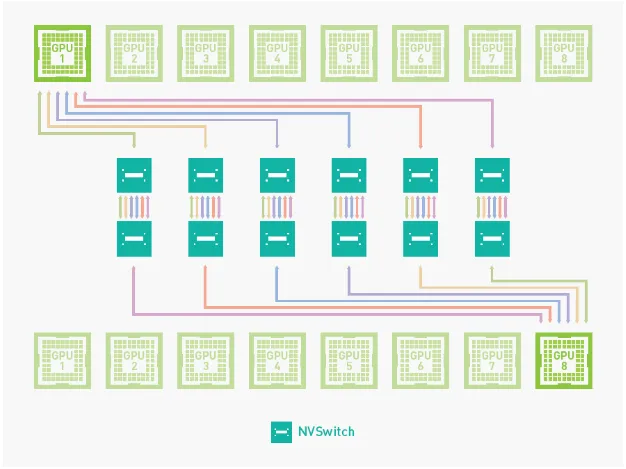

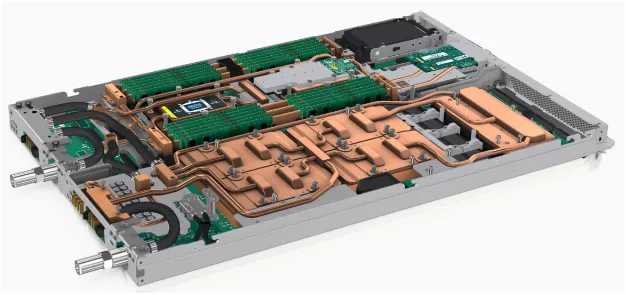

На фото: модуль H100 SXM и платформа HGX/NVSwitch — основа для 8-GPU узлов и кластеров.

Что означает SXM

SXM — модульный формат GPU, который работает в специализированных платформах (HGX/DGX). Главная ценность SXM — максимальная скорость обмена между GPU через NVLink/NVSwitch, что критично для обучения больших моделей и HPC.

Для каких задач SXM — лучший выбор

- training больших нейросетей и LLM

- multi-GPU workloads, где важна синхронизация

- HPC/научные расчёты

- проекты, где эффективность на 8 GPU важнее простоты интеграции

Минусы (честно)

- нужен совместимый сервер/платформа (не «любой PCIe-сервер»)

- выше требования к питанию/охлаждению

- дороже входной порог, но часто выше итоговая эффективность на больших задачах

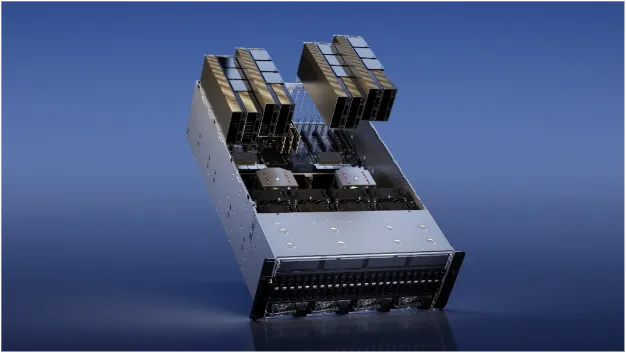

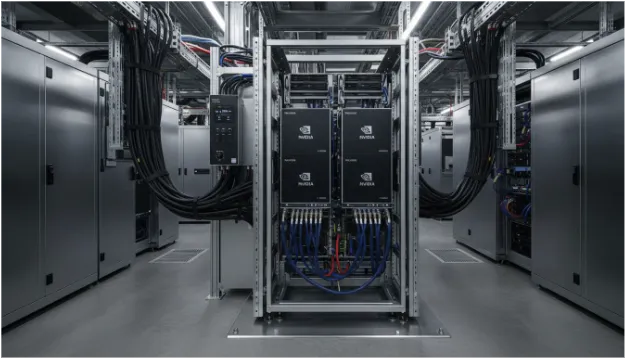

DGX H100 — готовая AI-платформа «под ключ»

На фото: NVIDIA DGX H100 — законченная система с 8 ускорителями H100 и инфраструктурой внутри.

Что такое DGX

DGX H100 — это готовый серверный комплекс NVIDIA, обычно с 8× H100 и общей GPU-памятью 640 GB (8×80 GB), с NVLink/NVSwitch-архитектурой, сетями и оптимизацией под NVIDIA-стек.

Для кого DGX — идеален

- enterprise-компании, которым нужен быстрый запуск без «сборки из кубиков»

- R&D-центры

- проекты, где цена простоя выше разницы в стоимости

Почему DGX покупают даже дороже

Потому что он снижает риски:

- совместимость железа/сети/охлаждения

- стабильность под нагрузкой

- предсказуемое масштабирование внутри узла

Сравнение всех модификаций H100

На фото: GPU-кластер в дата-центре — типовая среда, где раскрываются SXM/HGX/DGX решения.

|

Модификация |

Где используется |

Сильная сторона |

Сложность внедрения |

Типичные сценарии |

|

H100 PCIe (80GB) |

стандартные серверы |

простота интеграции |

низкая |

inference, продакшн-AI, 1–2 GPU |

|

H100 NVL (94GB) |

PCIe-серверы (multi-GPU) |

инференс больших моделей, память/полоса |

средняя |

high-load inference, multi-GPU inference |

|

H100 SXM (80GB) |

HGX/DGX-платформы |

максимум межGPU-связи |

высокая |

training LLM, HPC |

|

DGX H100 (8×H100) |

готовая платформа |

минимизация рисков, «под ключ» |

минимальная для заказчика |

enterprise AI, R&D |

Как выбрать H100 под свою задачу

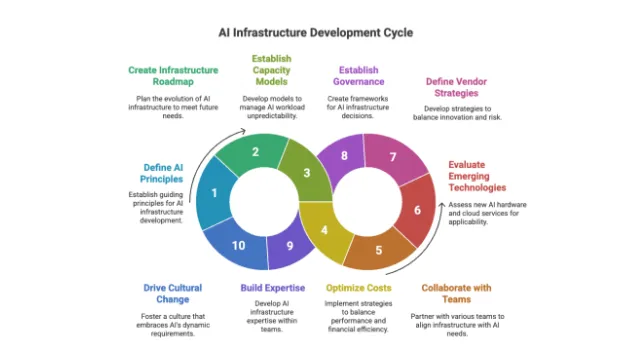

На фото: проектирование AI-инфраструктуры — этап, где правильный выбор форм-фактора экономит бюджет и сроки.

Ориентир, который работает в 90% случаев:

- Нужно быстро внедрить 1–2 GPU в текущий сервер и запустить продакшн-инференс → берите H100 PCIe.

- Нужно держать большие модели в памяти и масштабировать инференс в PCIe-сервере → смотрите H100 NVL 94GB.

- Нужно эффективно обучать большие модели на 4–8 GPU (и дальше масштабировать кластер) → чаще всего нужен SXM (HGX/DGX-архитектура).

- Нужно “без сюрпризов”: быстрый запуск, предсказуемая платформа, минимум интеграции → DGX H100.

Если сомневаетесь, задайте себе 2 вопроса:

- ваша задача — inference или training?

- планируется ли масштабирование до 4–8 GPU в ближайшие 6–12 месяцев?

Вывод

На фото: современный дата-центр с GPU-инфраструктурой — типичный контекст эксплуатации H100.

PCIe, NVL, SXM и DGX — это не “разные H100”, а разные способы использовать один класс ускорителя.

Правильный выбор форм-фактора:

- снижает риск переплаты

- ускоряет внедрение

- повышает реальную эффективность на вашей нагрузке

FAQ: NVIDIA H100 — PCIe, NVL, SXM и DGX

На фото: серверная эксплуатация GPU — то, что важно после покупки: установка, настройка, стабильность.

❓ Что означают PCIe, NVL, SXM и DGX у NVIDIA H100?

Это форм-факторы/способы интеграции H100: PCIe — в стандартный слот, NVL — вариант для эффективного multi-GPU инференса (часто 94GB), SXM — модуль для платформ с NVSwitch, DGX — готовая система.

❓ H100 PCIe подходит для LLM?

Да, особенно для инференса и продакшн-сервисов. Для обучения больших LLM на много GPU обычно эффективнее SXM/HGX/DGX из-за межGPU-связности.

❓ Чем H100 NVL отличается от H100 PCIe?

NVL ориентирован на сценарии инференса больших моделей и multi-GPU в PCIe-системах и часто имеет 94GB HBM3 (против 80GB у многих PCIe-вариантов).

❓ Зачем SXM, если есть PCIe?

SXM раскрывается там, где важна скорость обмена между несколькими GPU (NVLink/NVSwitch) — это критично для обучения и масштабирования на 4–8 GPU.

❓ Что такое DGX H100 и кому он нужен?

DGX — это «под ключ»: 8×H100, NVSwitch, сети и оптимизации. Его берут, чтобы быстро запустить платформу и снизить интеграционные риски.

❓ У всех вариантов H100 одинаковая производительность?

Производительность одного GPU близка по классу, но итоговый результат сильно зависит от: памяти/полосы, межGPU-связи, платформы, охлаждения и ПО-стека.