NVIDIA H100 — это ускоритель, который стал де-факто стандартом для крупных AI-проектов последних лет.

Его используют не потому, что «он самый новый», а потому что он универсально закрывает ключевые задачи: обучение, fine-tuning и промышленный инференс.

Ниже — реальные примеры компаний, которые используют NVIDIA H100 в продакшене, исследованиях и облачной инфраструктуре.

Perplexity: промышленный инференс LLM под высокой API-нагрузкой

На фото: серверная инфраструктура с GPU NVIDIA H100 для инференса языковых моделей.

Perplexity — это AI-платформа с постоянной пользовательской нагрузкой и публичным API.

В их случае ключевая задача — инференс больших языковых моделей с минимальной задержкой и стабильной работой под пиковыми нагрузками.

В инфраструктуре Perplexity NVIDIA H100 используется для:

- обслуживания тысяч параллельных запросов

- снижения latency ответа

- оптимизации стоимости инференса за счёт современных режимов вычислений

Особенность этого кейса в том, что H100 работает не в лабораторном режиме, а как часть постоянно нагруженного сервиса.

Почему здесь H100:

- высокая вычислительная плотность

- стабильность под нагрузкой

- универсальность для продакшен-инференса без сложной инфраструктуры

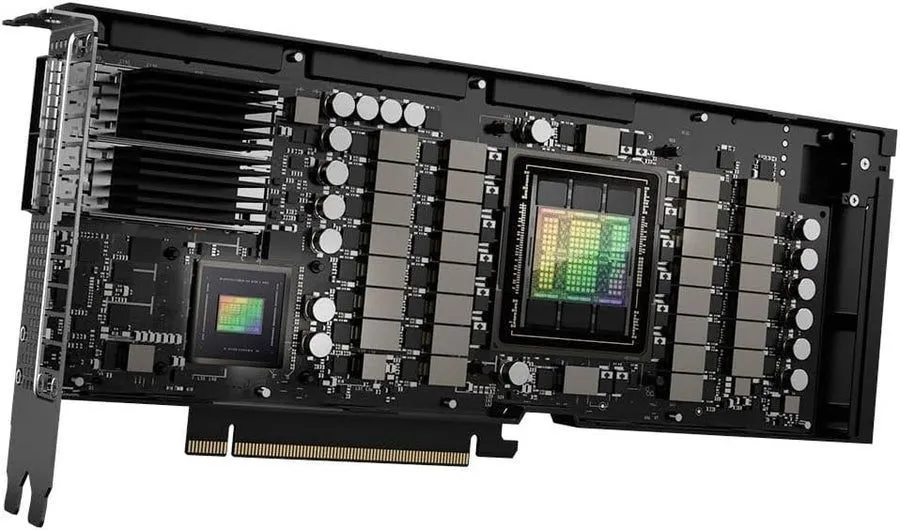

Foxconn: обучение корпоративного LLM для производства и supply chain

На фото: AI-кластер на базе NVIDIA H100 для обучения языковых моделей.

Foxconn использует кластер из десятков GPU NVIDIA H100 для обучения собственного корпоративного LLM.

Этот LLM применяется внутри компании для задач:

- анализа производственных данных

- работы с документацией и инструкциями

- поддержки принятия решений в цепочках поставок

Обучение велось в сжатые сроки, что критично для бизнеса такого масштаба.

Почему здесь H100:

- ускорение обучения больших моделей

- возможность быстро проводить итерации обучения и дообучения

- зрелая экосистема для training-нагрузок

Этот кейс хорошо показывает, как H100 используется внутри корпораций, а не только в AI-стартапах.

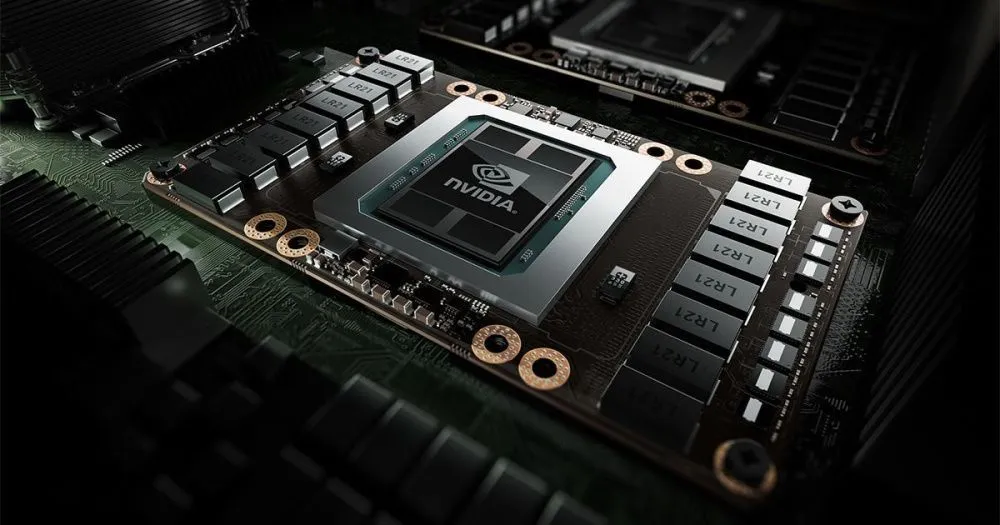

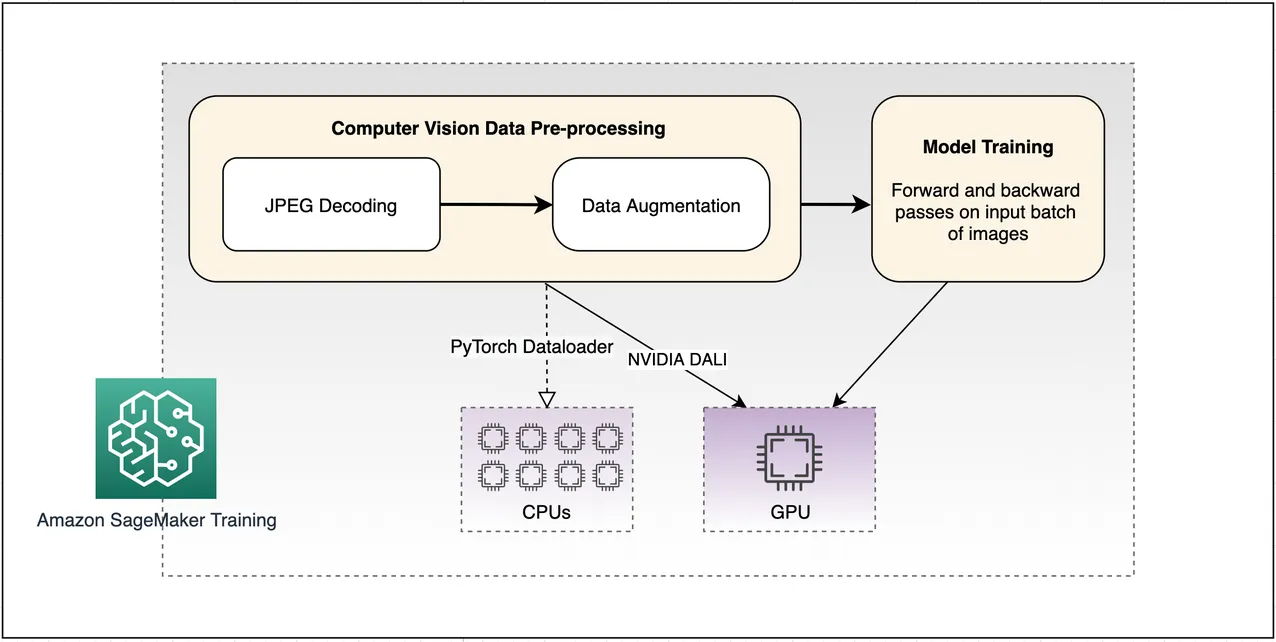

Tesla: обучение нейросетей автопилота на видеоданных

На фото: масштабный GPU-кластер для обучения моделей компьютерного зрения.

Для обучения систем автопилота Tesla используются огромные массивы видеоданных.

Такие задачи требуют:

- длительных тренировок

- высокой пропускной способности

- масштабирования на тысячи GPU

В этих проектах NVIDIA H100 применяется как строительный блок больших тренировочных кластеров.

Почему здесь H100:

- высокая эффективность в задачах компьютерного зрения

- масштабируемость на уровне кластера

- устойчивость при длительных тренировках

Для подобных сценариев важнее не «пиковые цифры», а способность стабильно обучать модели неделями.

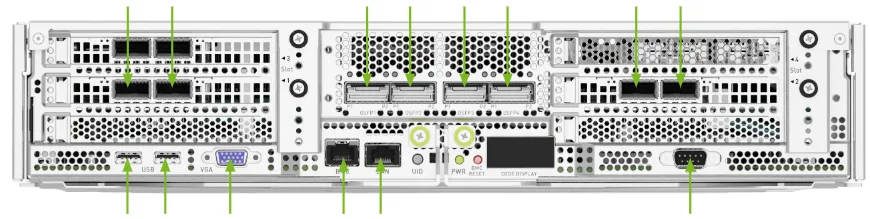

xAI (Colossus): H100 как стандарт для AI-фабрики

На фото: стойки AI-кластера с высокой плотностью GPU.

Проект xAI строит инфраструктуру по принципу AI-фабрики, где основным вычислительным элементом является узел с несколькими GPU H100.

Такая архитектура подразумевает:

- плотную установку GPU

- высокие требования к питанию и охлаждению

- масштабирование на уровне стоек и залов

В этом контексте H100 выбран как универсальный и предсказуемый ускоритель, вокруг которого удобно строить кластер.

Почему здесь H100:

- проверенная архитектура

- удобство масштабирования

- совместимость с широким спектром серверных платформ

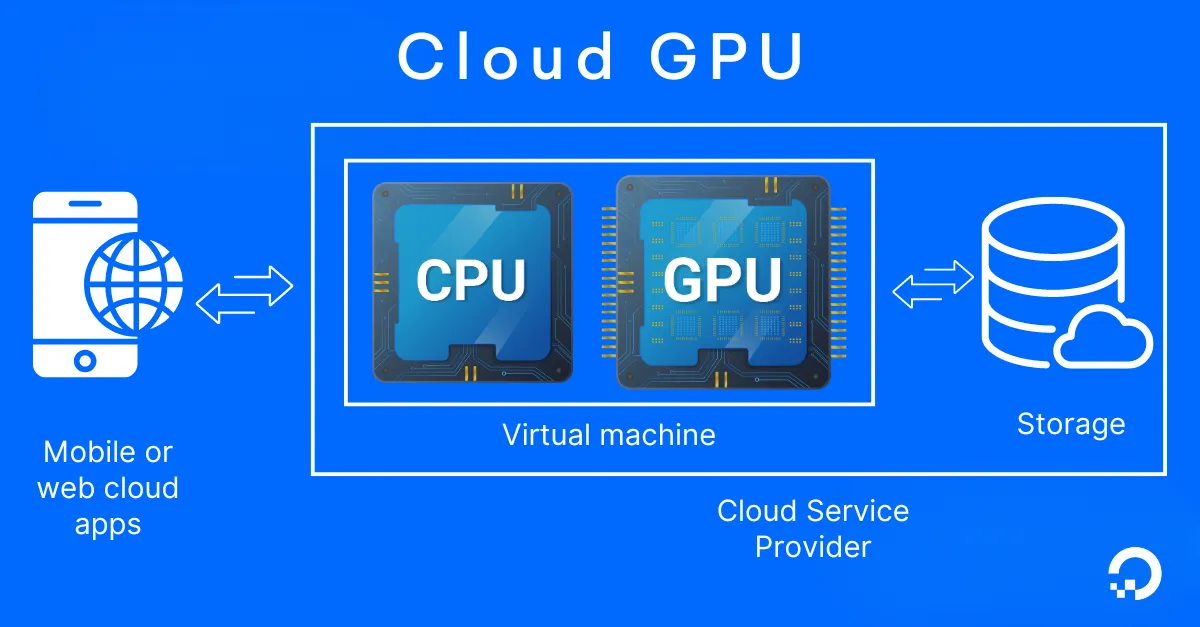

Scaleway: AI-суперкомпьютер как сервис на базе H100

На фото: архитектура AI-суперкомпьютера с использованием NVIDIA H100.

Европейский облачный провайдер Scaleway развернул AI-суперкомпьютер на базе более тысячи GPU NVIDIA H100.

Этот ресурс предоставляется:

- AI-стартапам

- исследовательским командам

- корпоративным заказчикам

В формате «вычисления как сервис».

Почему здесь H100:

- универсальность для разных типов задач

- возможность обслуживать и обучение, и инференс

- предсказуемая экономика для облачного провайдера

FPT: корпоративная AI-платформа и локальная AI-фабрика

На фото: установка и ввод в эксплуатацию DGX H100 в корпоративном дата-центре.

FPT внедрила DGX H100 как основу собственной AI-платформы.

Цель — создание локальной AI-фабрики для:

- разработки AI-продуктов

- корпоративных сервисов

- работы с большими языковыми моделями

H100 используется как базовый универсальный ускоритель, вокруг которого строится вся инфраструктура.

Почему здесь H100:

- сочетание обучения и инференса

- надёжность и поддержка

- удобство масштабирования в будущем

Что объединяет все эти проекты

Анализируя реальные внедрения H100, можно выделить общие закономерности:

- H100 редко покупают “одной картой” — почти всегда это сервер, узел или кластер

- Основные сценарии:

- обучение и дообучение моделей

- промышленный инференс

- Решающее значение имеет не только GPU, но и:

- архитектура сервера

- сеть

- охлаждение

- масштабирование

Вывод от редакции GIS Server

NVIDIA H100 — это универсальный ускоритель для AI-проектов, где:

- важны обучение и инференс

- требуется масштабирование

- нужен проверенный стандарт

Именно поэтому H100 остаётся основой большинства крупных AI-кластеров и AI-фабрик.

При подборе решений мы в GIS Server всегда смотрим:

- какую задачу решает проект

- на каком этапе жизненного цикла находится модель

- какой формат инфраструктуры нужен — сервер или кластер

Это позволяет выбрать конфигурацию, которая будет работать эффективно не на бумаге, а в реальной эксплуатации.