NVIDIA H200 — это не просто «следующая версия» H100.

Это ускоритель, который начали выбирать в проектах, где память и пропускная способность стали главным узким местом, а масштаб и стабильность важнее лабораторных бенчмарков.

В этой статье мы собрали реальные внедрения NVIDIA H200 — не абстрактные сценарии, а конкретные проекты компаний, университетов и облачных провайдеров.

Каждый кейс показывает, почему именно H200 оказался уместным, и какие задачи он закрывает на практике.

IONOS (Германия): DGX H200 для суверенных LLM и юридического ИИ

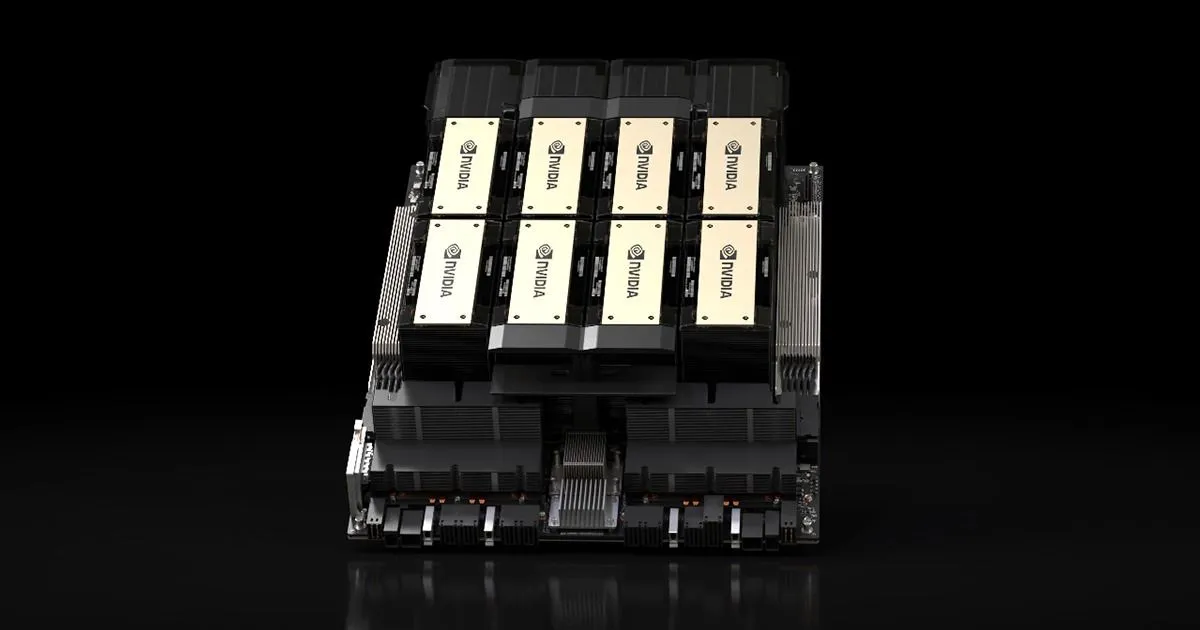

На фото: сервер NVIDIA DGX H200 в инфраструктуре дата-центра.

Европейский хостинг-провайдер IONOS развернул в своих дата-центрах системы NVIDIA DGX H200 и предоставил к ним доступ клиентам в формате управляемого сервиса.

Речь идёт не о тестовой лаборатории, а о промышленной AI-платформе, рассчитанной на:

- корпоративных заказчиков

- научные организации

- проекты с жёсткими требованиями к данным и юрисдикции

Одним из ключевых сценариев стало обучение и эксплуатация юридических языковых моделей, работающих с большими массивами текстов и длинным контекстом.

Для таких задач критичны:

- объём памяти одного GPU

- скорость доступа к данным

- стабильность под постоянной нагрузкой

Почему здесь выбран H200:

Юридические LLM часто упираются не в вычисления, а в память. H200 позволяет держать большие контексты и массивы документов целиком в HBM, снижая необходимость сложного шардирования и ускоряя inference.

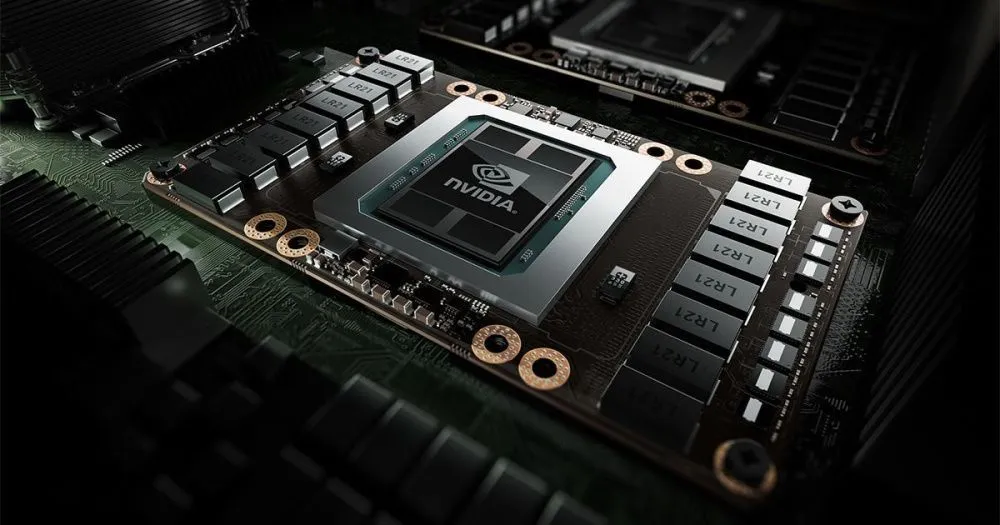

La Trobe University (Австралия): медицинский и биотех-ИИ на DGX H200

На фото: AI-суперкомпьютер на базе DGX H200, используемый в научных исследованиях.

Австралийский университет La Trobe ввёл в эксплуатацию несколько систем DGX H200 в рамках своей исследовательской AI-платформы.

Основной фокус:

- медицинские исследования

- биотехнологии

- работа с изображениями, геномными данными и сложными датасетами

В таких проектах нагрузка часто выглядит так:

- большие объёмы данных

- сложные модели

- много итераций обучения и инференса

Почему здесь выбран H200:

В медицине и биотехе данные «тяжелее», чем код.

H200 позволяет:

- держать больше данных в памяти

- быстрее прокручивать циклы экспериментов

- сокращать время от гипотезы до результата

Для исследовательских команд это означает не «больше TFLOPS», а больше экспериментов за то же время.

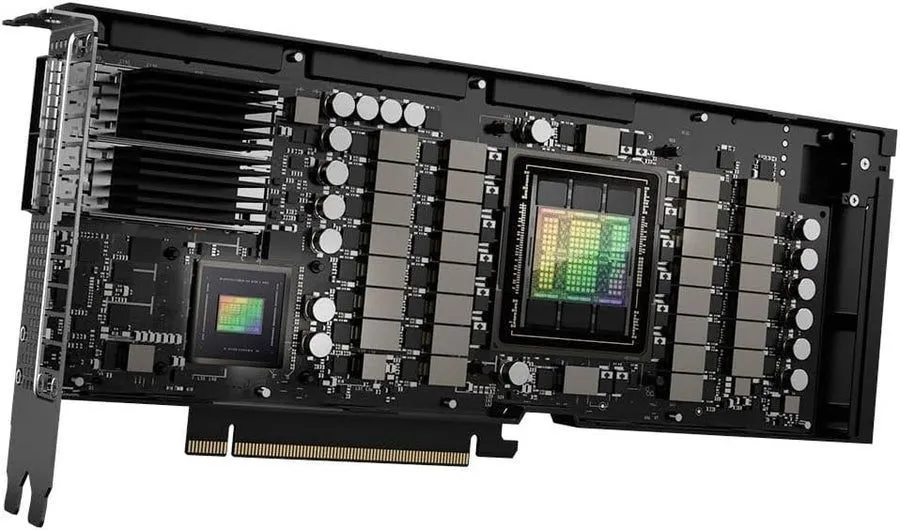

Cirrascale (США): HGX H200 как 8-GPU платформа для GenAI и HPC

На фото: серверная платформа NVIDIA HGX H200 с восемью ускорителями.

GPU-облачный провайдер Cirrascale добавил в свою инфраструктуру HGX H200 — это узлы с 8 GPU, объединённые через NVSwitch.

Такие системы ориентированы на:

- генеративный ИИ

- крупный inference LLM

- обучение и дообучение моделей

- HPC-нагрузки

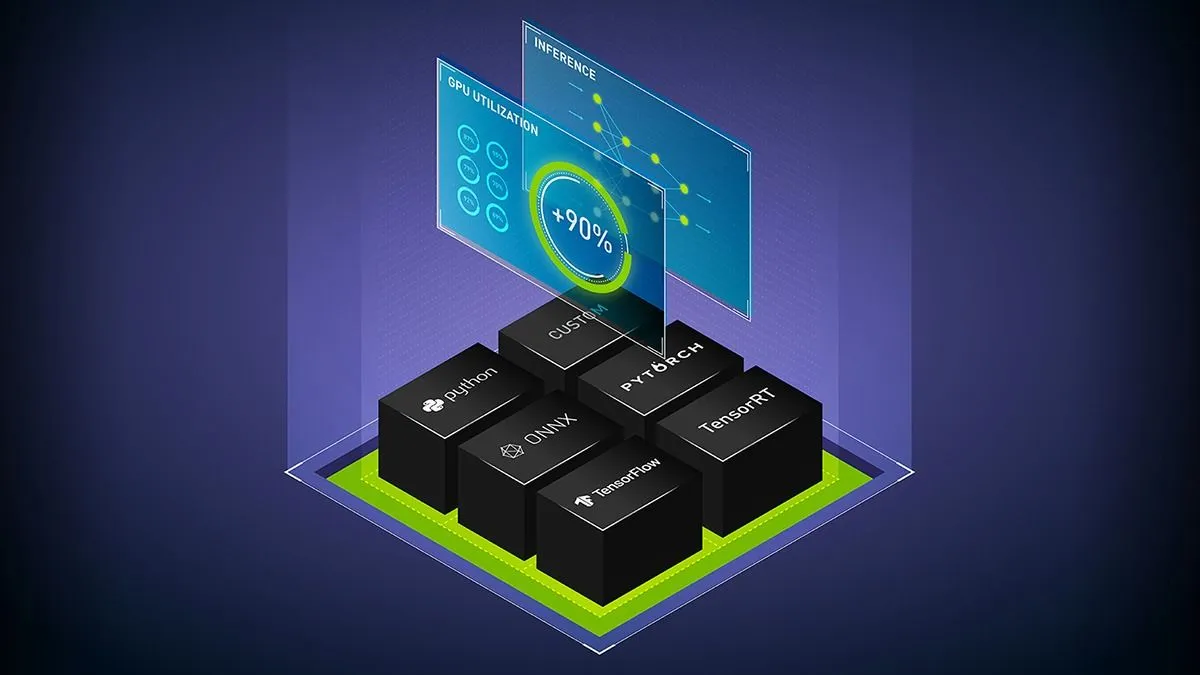

Здесь важно понимать:

клиенты покупают не одну видеокарту, а вычислительный узел, где ключевую роль играет связность между GPU и суммарная память.

Почему здесь выбран H200:

В 8-GPU конфигурациях H200 даёт:

- огромный общий пул памяти

- высокую пропускную способность

- эффективную работу больших моделей без дробления

Это типичный сценарий, где H200 раскрывается на уровне платформы, а не отдельной карты.

CoreWeave (США): коммерческое облако на H200 для обучения и inference LLM

На фото: инфраструктура GPU-облака для масштабных AI-нагрузок.

CoreWeave — один из крупных специализированных GPU-провайдеров — начал предлагать вычислительные ресурсы на базе NVIDIA H200 в своём облаке.

Такая инфраструктура используется компаниями, которые:

- обучают собственные большие языковые модели

- делают масштабный inference

- не хотят ждать месяцы поставки железа

Типичный профиль клиентов:

- разработчики LLM

- AI-стартапы

- компании с подписочной моделью и пиковыми нагрузками

Почему здесь выбран H200:

В коммерческом AI-облаке важно:

- снизить latency

- увеличить плотность нагрузки на GPU

- уменьшить стоимость одного запроса или токена

H200 позволяет провайдерам обслуживать больше клиентов с меньшим количеством ускорителей — а это напрямую влияет на экономику сервиса.

Япония: локальные GPU-облака и дата-центры на H200

На фото: AI-дата-центр с GPU-инфраструктурой в Азии.

В Японии несколько крупных технологических и телеком-групп начали строить локальные AI-облака на базе H200.

Цели таких проектов:

- предоставить корпоративным клиентам доступ к GenAI

- обеспечить хранение и обработку данных внутри страны

- запустить отраслевые AI-сервисы (финансы, промышленность, телеком)

Почему здесь выбран H200:

Корпоративные клиенты часто работают с большими моделями и чувствительными данными.

H200 позволяет:

- запускать большие LLM без распределения по десяткам GPU

- снизить задержки

- упростить архитектуру сервисов

Nebius: крупный H200-кластер как основа AI-фабрики

На фото: масштабируемый GPU-кластер в современном дата-центре.

Компания Nebius начала развёртывание крупного кластера на базе NVIDIA H200, рассчитанного на промышленный масштаб.

Такие проекты — это уже не «серверная», а AI-фабрика:

- десятки и сотни GPU

- серьёзные требования к питанию и охлаждению

- сложная сеть и оркестрация

Почему здесь выбран H200:

На масштабе кластера:

- память и пропускная способность определяют эффективность сильнее, чем “пиковые FLOPS”

- важна плотность вычислений и стабильность под нагрузкой

H200 в таких проектах — это фундамент для масштабируемой AI-инфраструктуры.

Что объединяет все эти проекты

Если посмотреть на все кейсы вместе, становится очевидно:

- H200 почти всегда используется как часть платформы — DGX, HGX, кластер, облако

- Основной фокус — LLM, GenAI, inference, большие контексты

- Покупатели считают не цену карты, а:

- стоимость одного запроса

- плотность нагрузки

- простоту архитектуры

Вывод от редакции GIS Server

NVIDIA H200 выбирают не потому, что это «самая новая карта», а потому что:

- современные AI-проекты упираются в память

- инференс стал важнее обучения

- экономику считают на уровне сервиса, а не железа

Именно поэтому при подборе H200 мы всегда смотрим:

- какая задача решается

- в каком формате будет использоваться GPU

- один это сервер или масштабируемая платформа

Если нужно — мы поможем определить, где H200 действительно оправдан, а где H100 будет рациональнее.