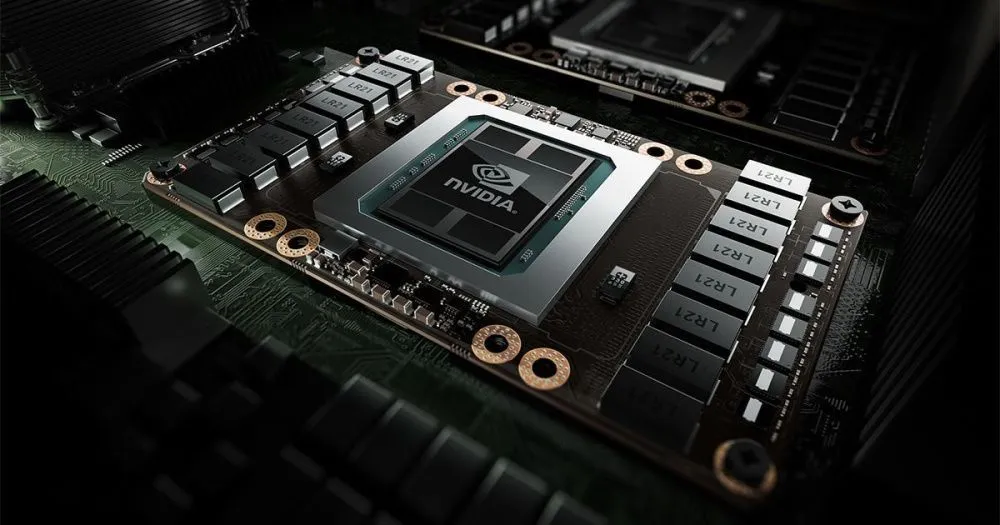

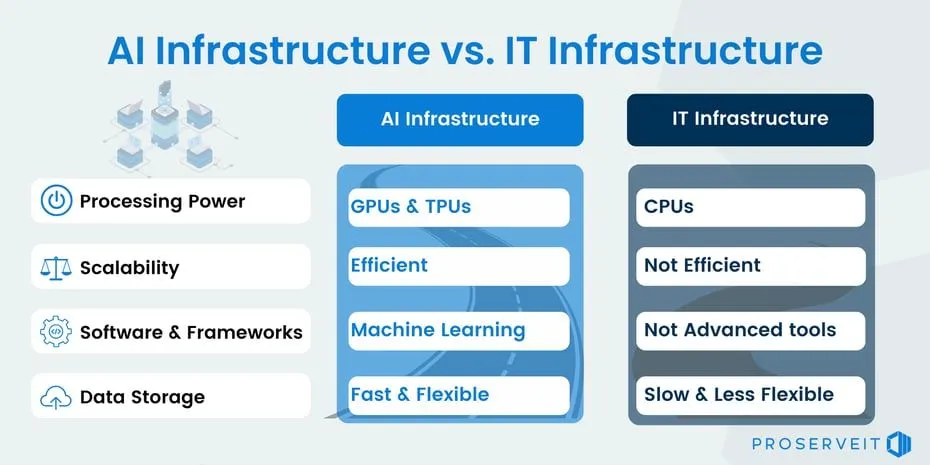

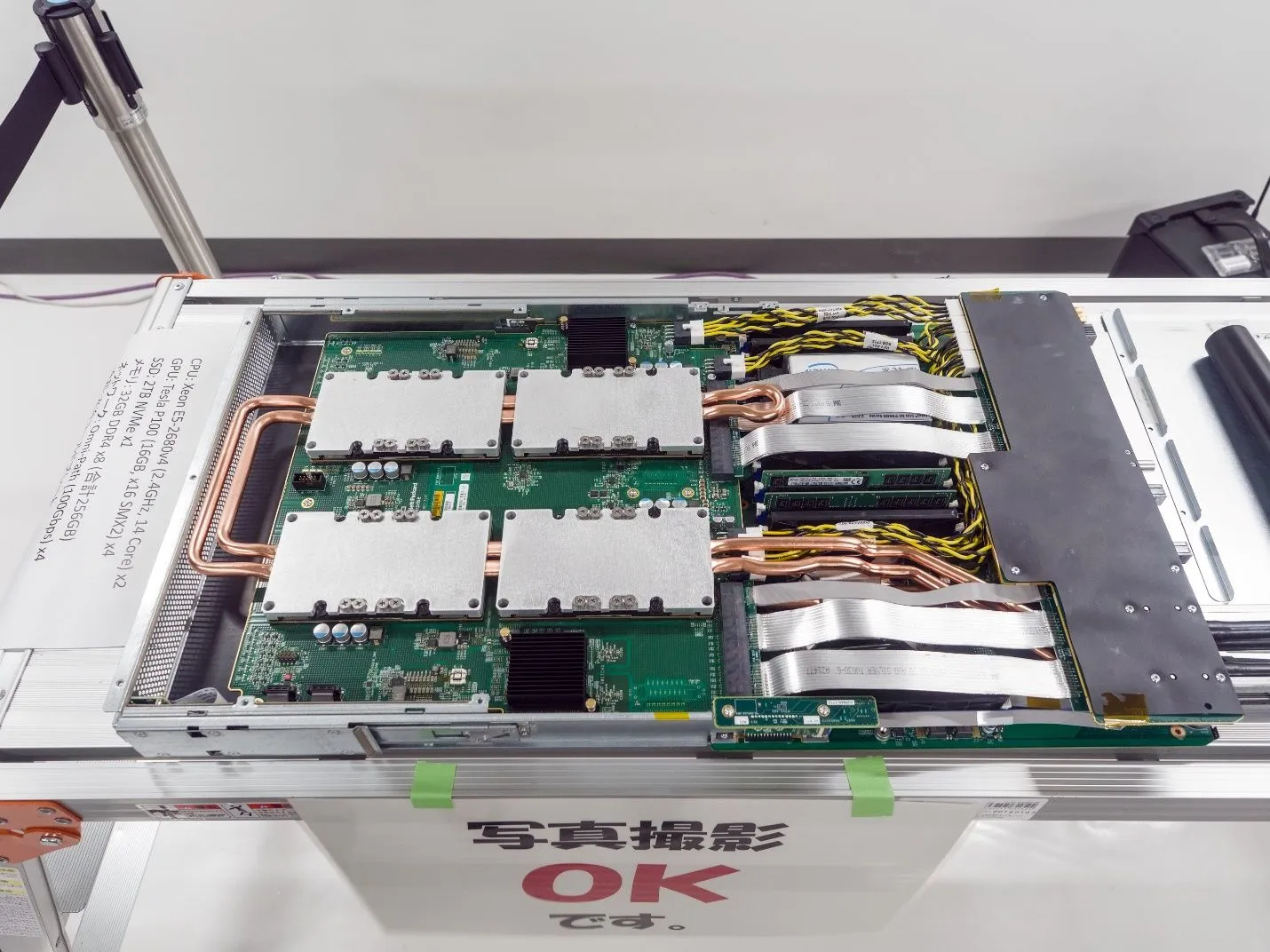

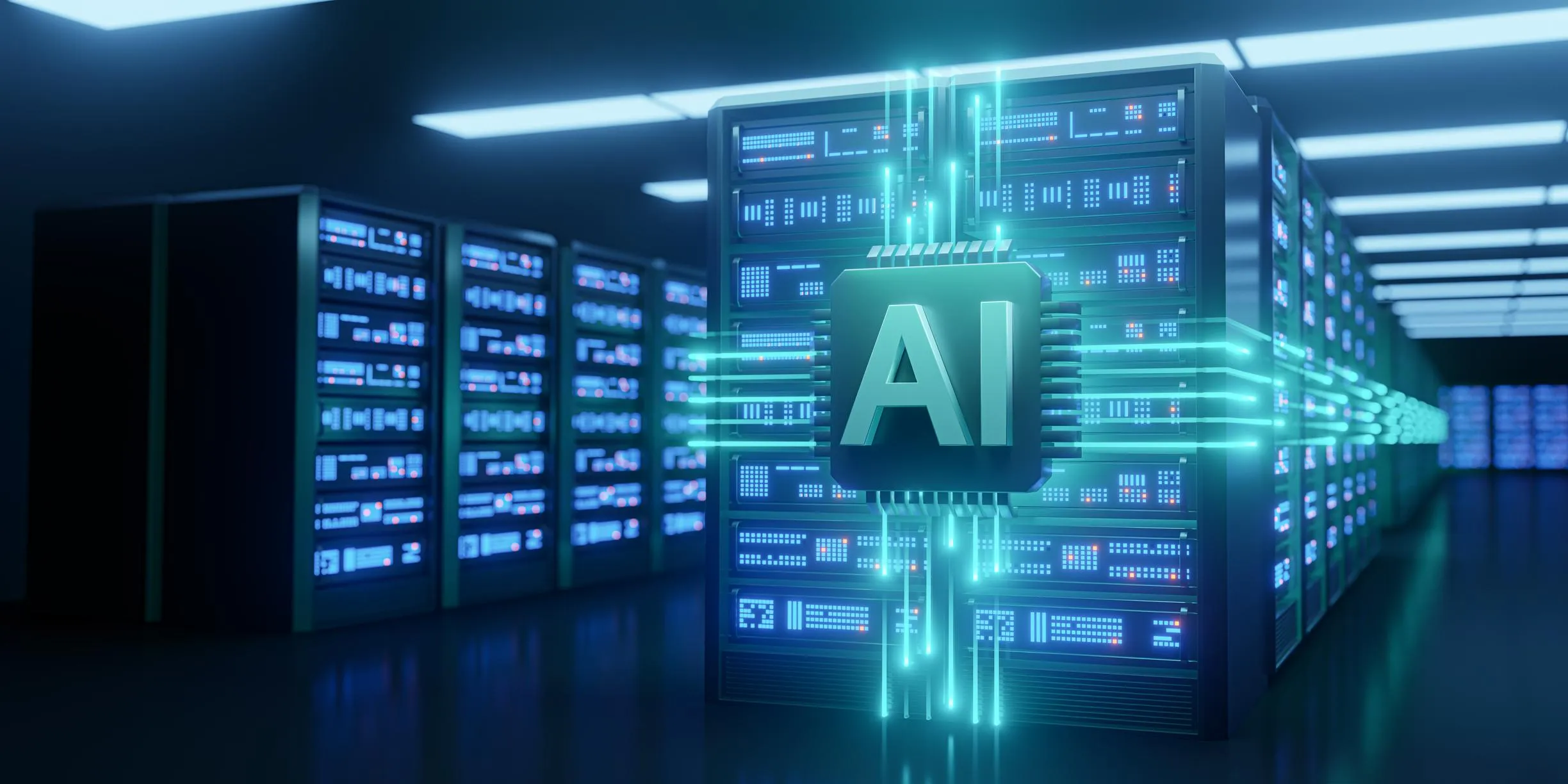

На фото: серверные ускорители NVIDIA, используемые в дата-центрах и AI-кластерах.

В сегменте серверных GPU всё чаще встречается формулировка OEM-ускорители NVIDIA.

Для кого-то это очевидный формат, для кого-то — источник сомнений:

оригинал ли это, есть ли риски, почему дешевле и кому вообще подходит такой вариант?

OEM — это не конкретная модель и не «альтернатива» оригиналу.

Это формат поставки и эксплуатации, который изначально создавался для дата-центров и корпоративных инфраструктур.

Разберёмся, что на самом деле означает OEM в мире NVIDIA и AI-ускорителей.

Что означает OEM в контексте серверных GPU NVIDIA

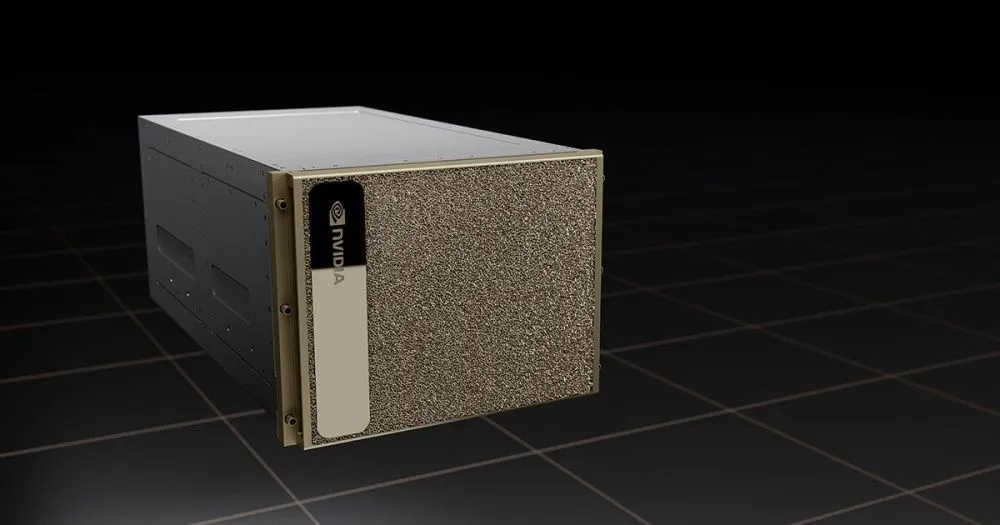

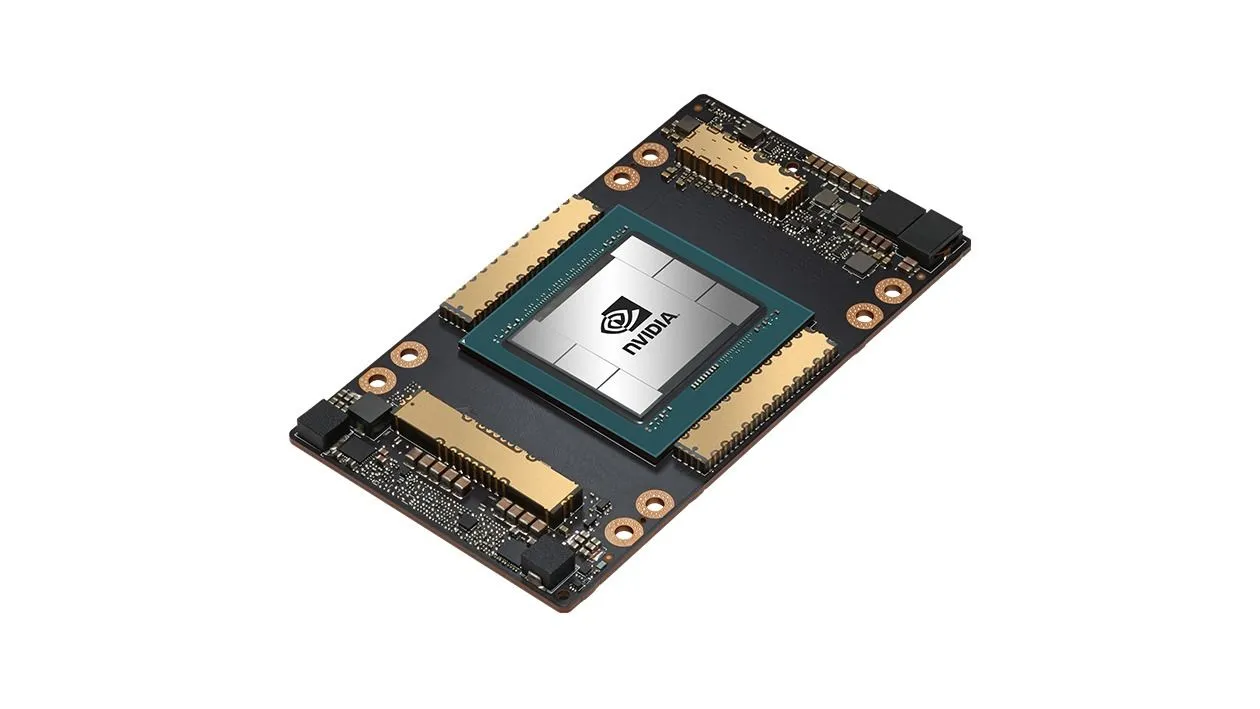

На фото: установка OEM-ускорителей в серверную инфраструктуру.

OEM (Original Equipment Manufacturer) в сегменте NVIDIA означает, что ускоритель:

- произведён NVIDIA или сертифицированным партнёром

- использует оригинальный чип NVIDIA (Ampere, Hopper и др.)

- предназначен для интеграции в серверы, платформы и кластеры

Ключевой момент:

👉 OEM — это не “другая версия GPU”

👉 OEM — это формат поставки без розничной оболочки

По вычислительной части OEM-ускоритель идентичен своему брендированному аналогу.

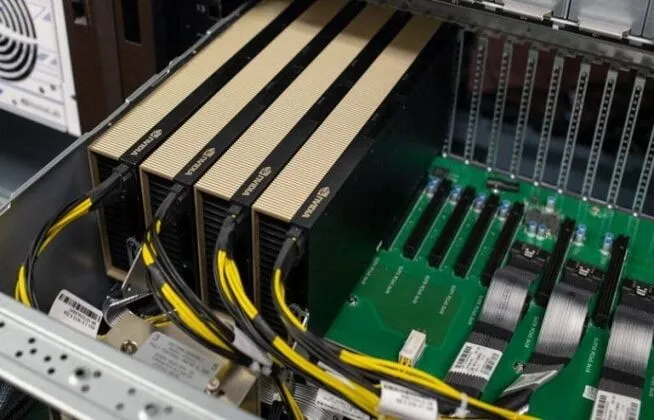

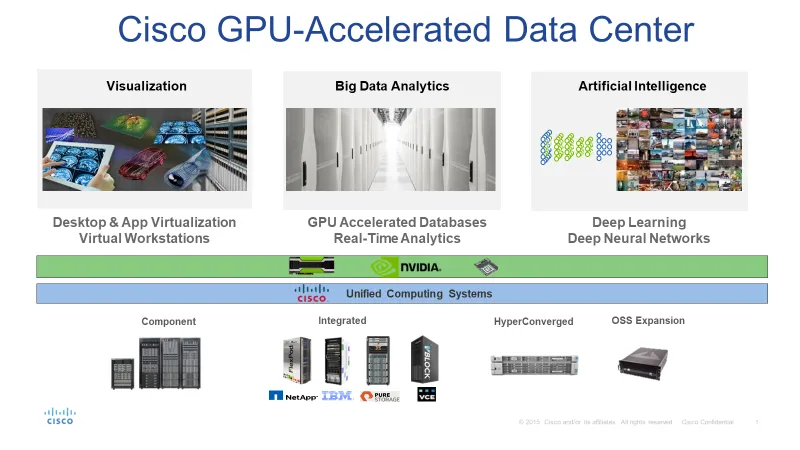

Почему OEM — это стандарт для дата-центров, а не «упрощение»

На фото: GPU-серверы в промышленном дата-центре.

Розничная логика («коробка, комплект, инструкция») появилась для удобства конечного пользователя.

В дата-центре она не имеет ценности.

В серверной среде важнее:

- совместимость с платформой

- охлаждение и airflow

- стабильность под нагрузкой

- экономика на уровне кластера

Поэтому OEM-ускорители — это основной формат, в котором GPU NVIDIA попадают:

- в облака

- в AI-кластеры

- в корпоративные платформы

- в суперкомпьютеры

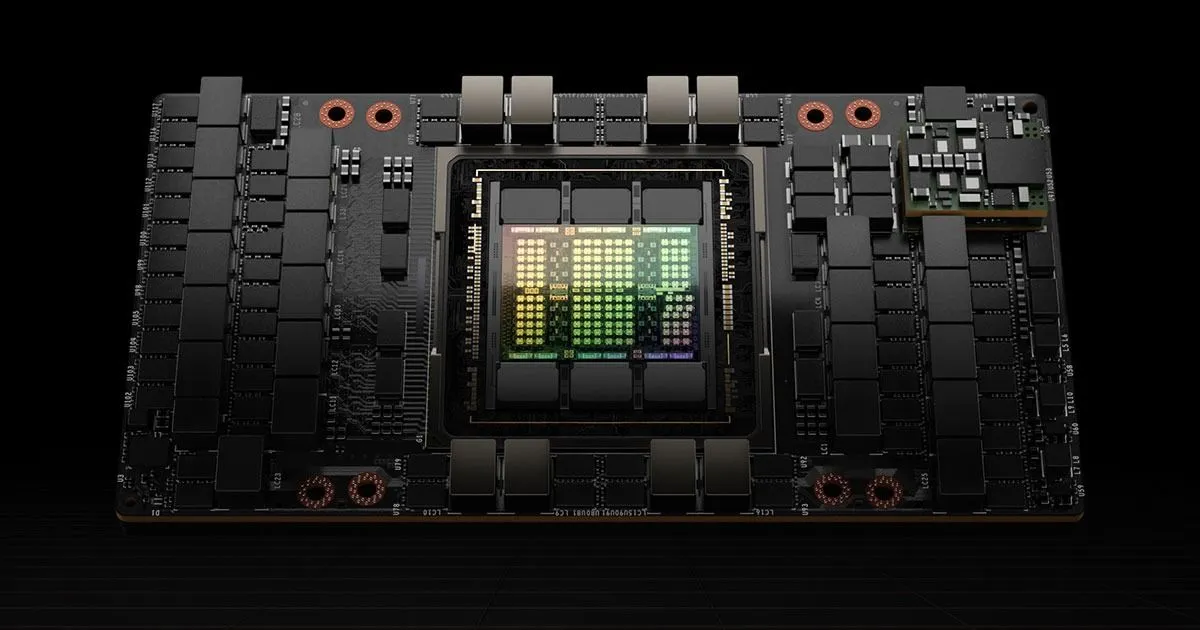

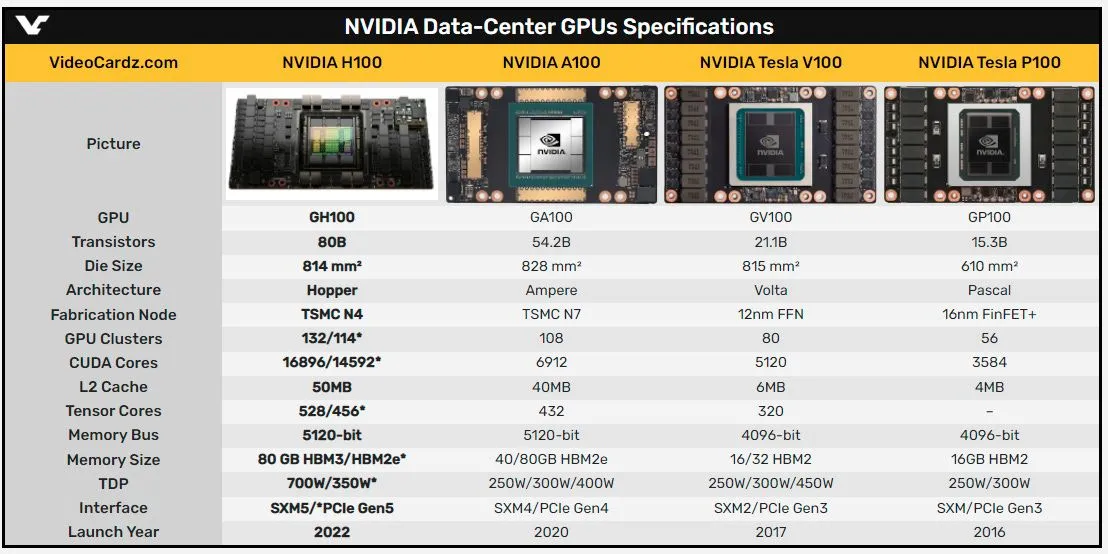

Какие ускорители NVIDIA чаще всего встречаются в OEM-исполнении

4

На фото: различные серверные ускорители NVIDIA, доступные в OEM-формате.

В OEM-формате чаще всего поставляются:

- NVIDIA A100

- NVIDIA H100

- NVIDIA H200

- NVIDIA L40 / L40S

- другие серверные ускорители для AI и HPC

Объединяет их одно:

они не предназначены для пользовательских ПК, а для серверов и дата-центров.

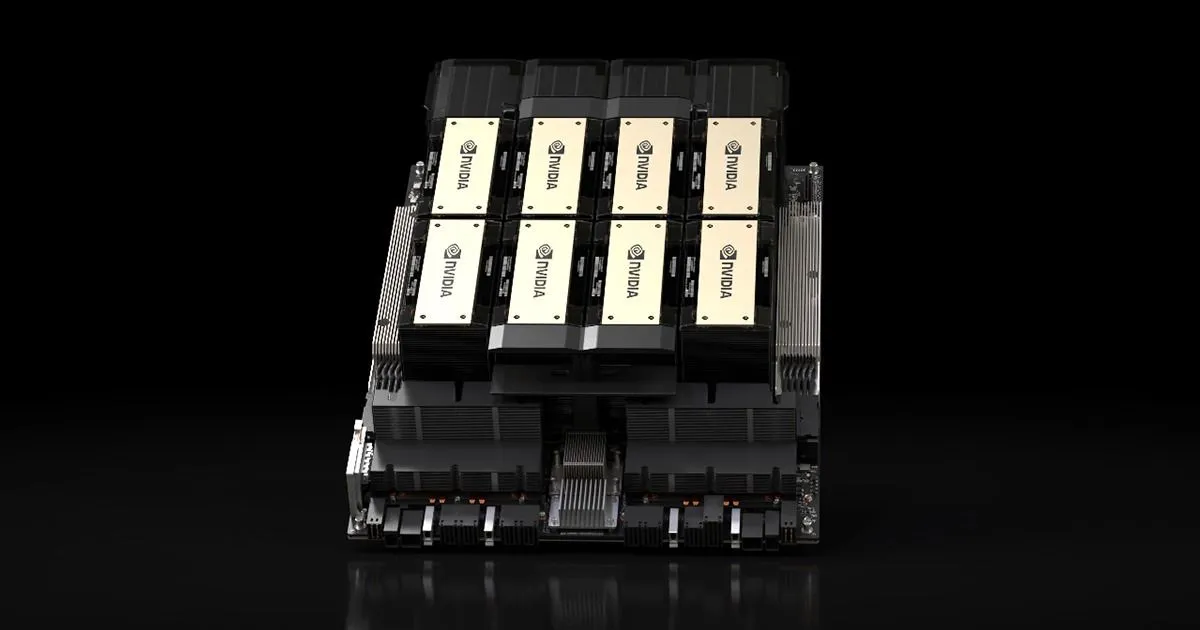

OEM и форм-факторы: где проходит реальная граница

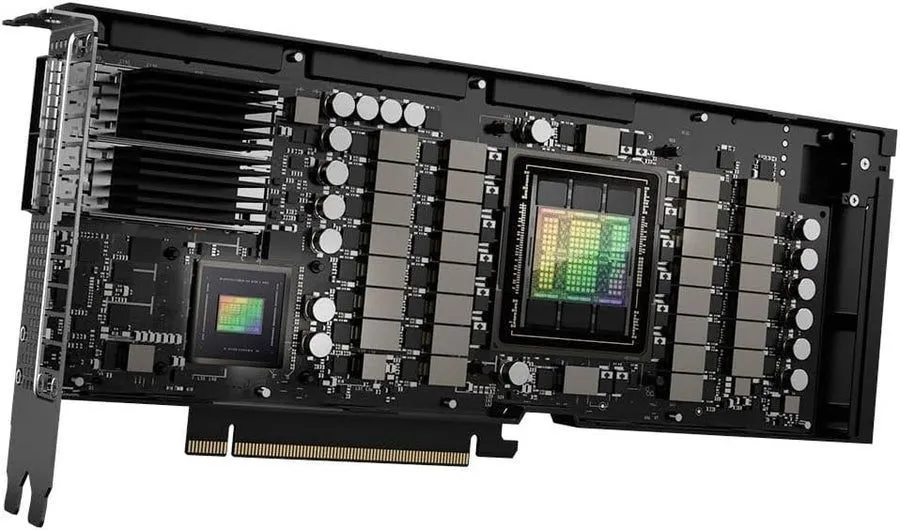

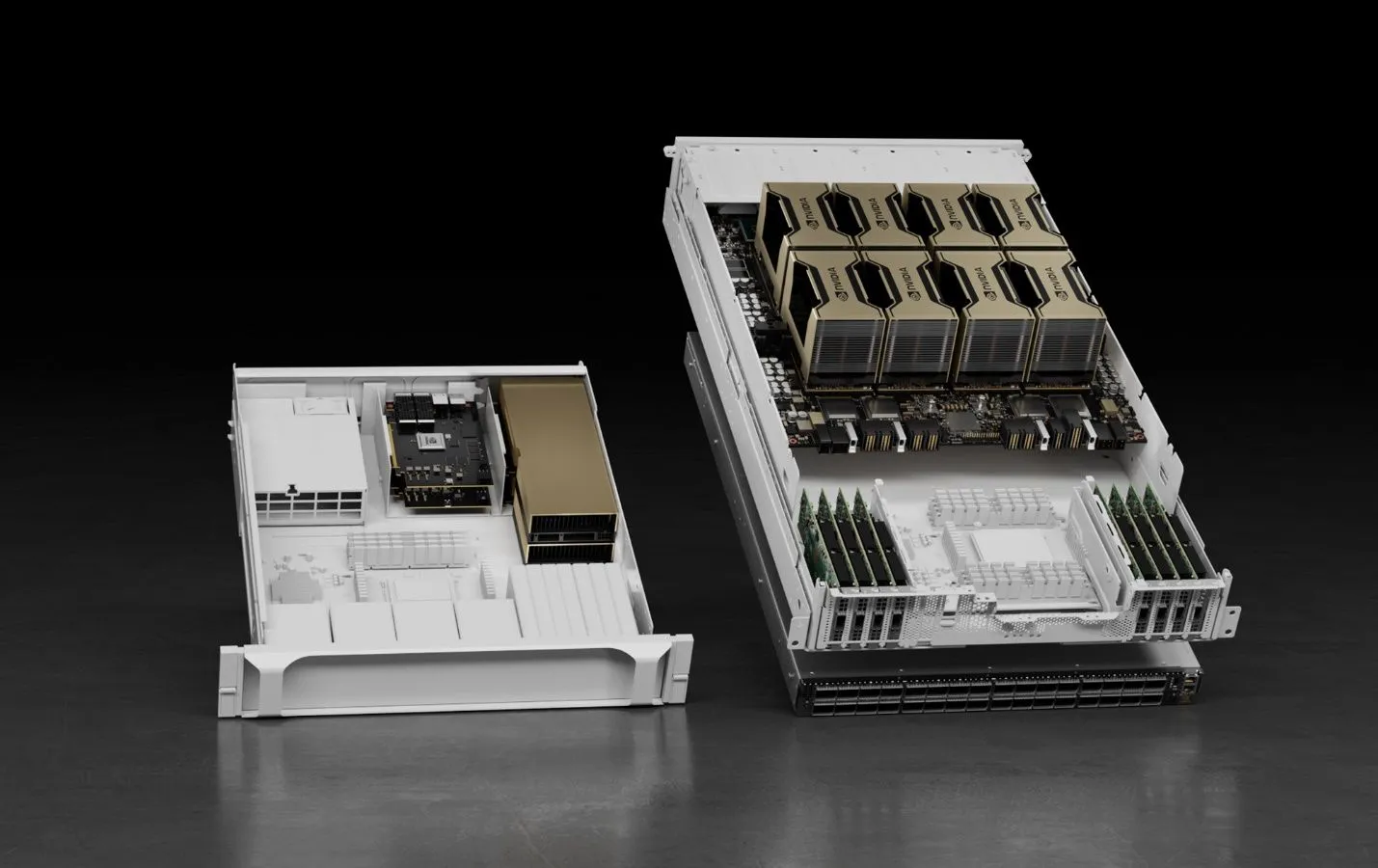

На фото: PCIe-карты и модульные ускорители SXM в серверных платформах.

OEM-формат тесно связан с форм-фактором ускорителя.

PCIe-ускорители (OEM)

- стандартный PCIe-разъём

- пассивное охлаждение

- установка в сервер с правильным airflow

Используются для:

- inference

- обучения средней плотности

- серверов с 1–4 GPU

Модульные ускорители (SXM / HGX)

- работают только в специализированных платформах

- высокая плотность GPU

- NVLink / NVSwitch

Используются для:

- обучения больших моделей

- плотных AI-кластеров

- DGX- и HGX-систем

OEM-формат не ограничивает ни один из этих сценариев.

Производительность и OEM: что важно понимать

На фото: AI-кластер для обучения и инференса.

С инженерной точки зрения:

- вычислительная производительность OEM и бренд-версии одинакова

- поддержка CUDA, TensorRT, NCCL — идентична

- multi-GPU и NVLink работают одинаково

Разница не в том, что умеет GPU, а в том, кто отвечает за инфраструктуру вокруг него.

Firmware, драйверы и эксплуатация OEM-ускорителей

На фото: мониторинг и управление серверными GPU.

OEM-ускорители предполагают, что:

- обновления драйверов выполняются централизованно

- firmware управляется через стандартные инструменты

- мониторинг ведётся на уровне сервера или кластера

Для команд с IT-отделом или DevOps это нормальный и ожидаемый сценарий.

Для одиночных пользователей — может быть непривычно.

Гарантия и поддержка в OEM-формате

На фото: обслуживание и поддержка серверной инфраструктуры.

OEM-поставка меняет модель поддержки:

- гарантия чаще идёт от поставщика или интегратора

- поддержка оформляется через SLA

- важна прозрачность условий замены и ремонта

Это не хуже и не лучше, а другая модель, привычная для B2B и дата-центров.

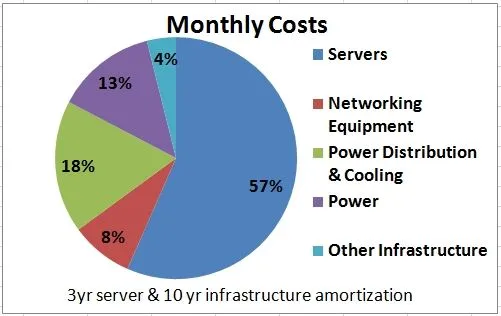

Почему OEM-ускорители NVIDIA дешевле

На фото: расчёт экономики AI-инфраструктуры.

Разница в цене возникает из-за:

- отсутствия розничной упаковки

- отсутствия маркетинговой наценки

- проектных партий

- более простой логистики

Для бизнеса это означает:

- меньший CapEx

- более дешёвое масштабирование

- выгодную стоимость вычислений

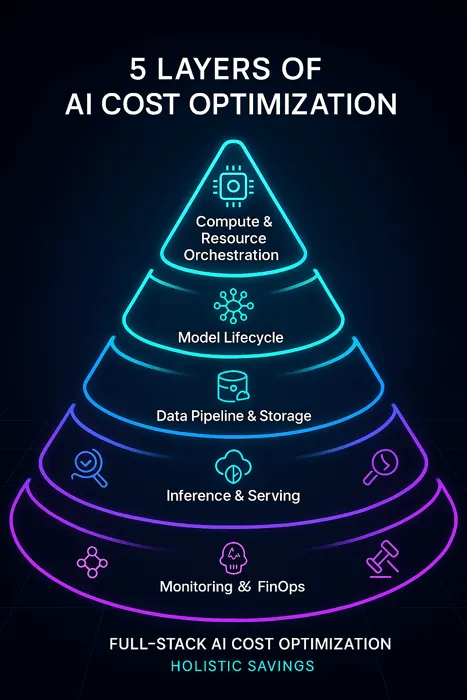

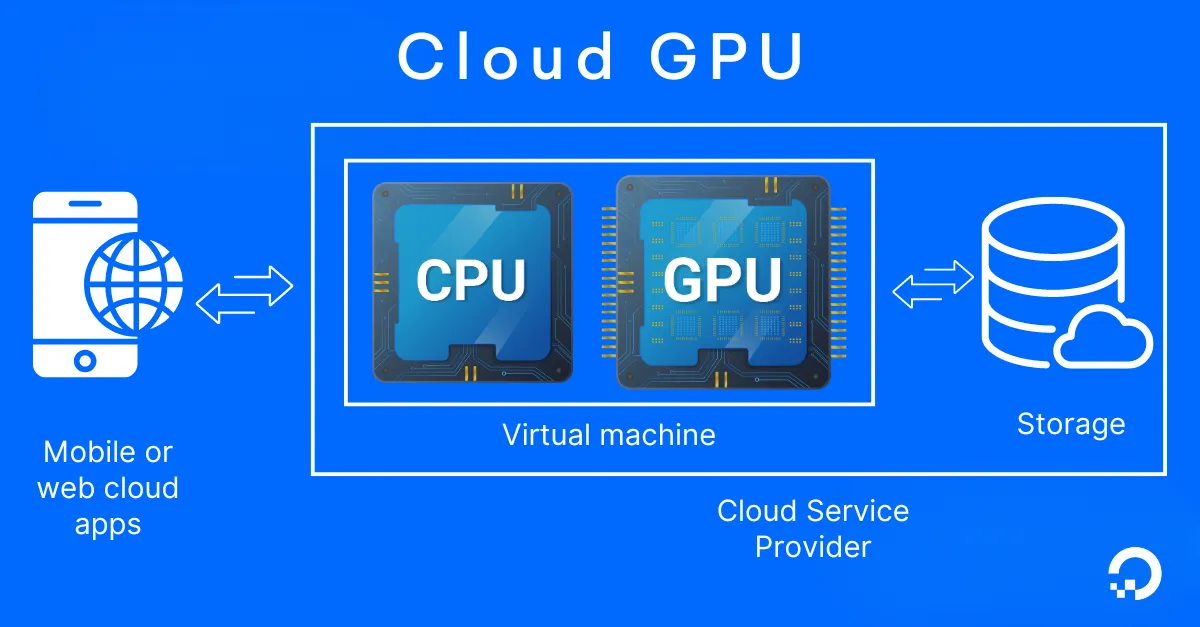

Для каких задач OEM-ускорители NVIDIA подходят лучше всего

На фото: корпоративная AI-платформа и GPU-облако.

OEM-формат оптимален для:

- AI-кластеров

- GPU-облаков

- корпоративных AI-платформ

- обучения и inference LLM

- HPC и научных расчётов

Общий признак — осознанное использование инфраструктуры.

Когда OEM-формат может быть не лучшим выбором

На фото: среда, не рассчитанная на серверные ускорители.

OEM может быть неудобен, если:

- нет серверного охлаждения

- GPU покупается «один раз и навсегда»

- ожидается пользовательский формат поддержки

В таких случаях разумнее рассматривать готовые решения или брендированные платформы.

Вывод от редакции GIS Server

На фото: современная AI-инфраструктура корпоративного уровня.

OEM-ускорители NVIDIA — это не компромисс, а профессиональный стандарт для AI-и HPC-проектов.

Они:

- дают ту же производительность

- обеспечивают лучшую экономику

- упрощают масштабирование

Но требуют:

- корректной инфраструктуры

- понимания серверной архитектуры

- грамотного поставщика

Именно поэтому OEM-формат выбирают облака, корпорации и AI-команды, для которых важен результат, а не упаковка.